Differentiable Learning of Logical Rules for Knowledge Base Reasoning(Neural LP) 논문 리뷰

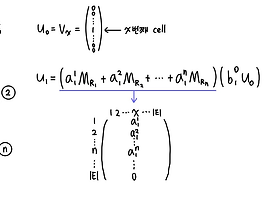

Paper :Main interest지식 그래프(Knowledge graph, KG)는 방대한 크기의 정보 담고 있으며 2개의 entity(h, t)와 1개의 relation(r)으로 하나의 triplet을 구성하고 이것이 KG의 데이터 단위가 된다. 예를 들어 $(h, r, t)$로 triplet을 표현할 수 있고 조금 더 relation 중심으로 표현하면 $r(h, t)$로 표기할 수 있다. 다만 주의해야 할 것은 일반적으로 $(h, r, t)$는 h->r->t를 의미하지만 이 연구에서는 $r(h, t)$를 더 많이 사용하고 t->h 방향으로 relation이 뻗어간다. 앞으로 글에서 $r(h, t)$를 표준으로 사용하겠다. 다양한 데이터를 담고 있는 만큼 지식 데이터(Knowledge base, K..

Differentiable Learning of Logical Rules for Knowledge Base Reasoning(Neural LP) 논문 리뷰

Paper :Main interest지식 그래프(Knowledge graph, KG)는 방대한 크기의 정보 담고 있으며 2개의 entity(h, t)와 1개의 relation(r)으로 하나의 triplet을 구성하고 이것이 KG의 데이터 단위가 된다. 예를 들어 $(h, r, t)$로 triplet을 표현할 수 있고 조금 더 relation 중심으로 표현하면 $r(h, t)$로 표기할 수 있다. 다만 주의해야 할 것은 일반적으로 $(h, r, t)$는 h->r->t를 의미하지만 이 연구에서는 $r(h, t)$를 더 많이 사용하고 t->h 방향으로 relation이 뻗어간다. 앞으로 글에서 $r(h, t)$를 표준으로 사용하겠다. 다양한 데이터를 담고 있는 만큼 지식 데이터(Knowledge base, K..

Embedding Entities And Relations For Learning And Inference In Knowledge Bases(DistMult) 논문 리뷰

Paper : Main Interest 지식 그래프(Knowledge Graph ; KG)는 노드와 노드 간의 연결을 간선에 저장한다. 기존의 그래프와의 차이점은 간선이 오직 방향성(in, out, undirected) 뿐만 아니라 간선의 종류(relation)에 의존한다는 것이다. 즉 데이터는 triplet 꼴로 저장이 되는데, 예시로 (Obama, born in, Hawai), (Hawai, state of, USA)이 있다. 이러한 지식 데이터(Knowledge Base ; KB)를 모델에 학습시켜 추천 시스템부터 시작해 사실 확인, 검색 엔진, NLP 등 여러 분야에서 사용할 수 있다. 그렇다면 모델 학습은 어떻게 시켜야 할까? KB를 효율적이게 학습하고자 여러 시도들이 있었고 그중 가장 인기..

Embedding Entities And Relations For Learning And Inference In Knowledge Bases(DistMult) 논문 리뷰

Paper : Main Interest 지식 그래프(Knowledge Graph ; KG)는 노드와 노드 간의 연결을 간선에 저장한다. 기존의 그래프와의 차이점은 간선이 오직 방향성(in, out, undirected) 뿐만 아니라 간선의 종류(relation)에 의존한다는 것이다. 즉 데이터는 triplet 꼴로 저장이 되는데, 예시로 (Obama, born in, Hawai), (Hawai, state of, USA)이 있다. 이러한 지식 데이터(Knowledge Base ; KB)를 모델에 학습시켜 추천 시스템부터 시작해 사실 확인, 검색 엔진, NLP 등 여러 분야에서 사용할 수 있다. 그렇다면 모델 학습은 어떻게 시켜야 할까? KB를 효율적이게 학습하고자 여러 시도들이 있었고 그중 가장 인기..